Sottoscriviti ora

Sottoscriviti ora, e verrai costantemente aggiornato su tutte le novità del mondo IoT e dei miei corsi!

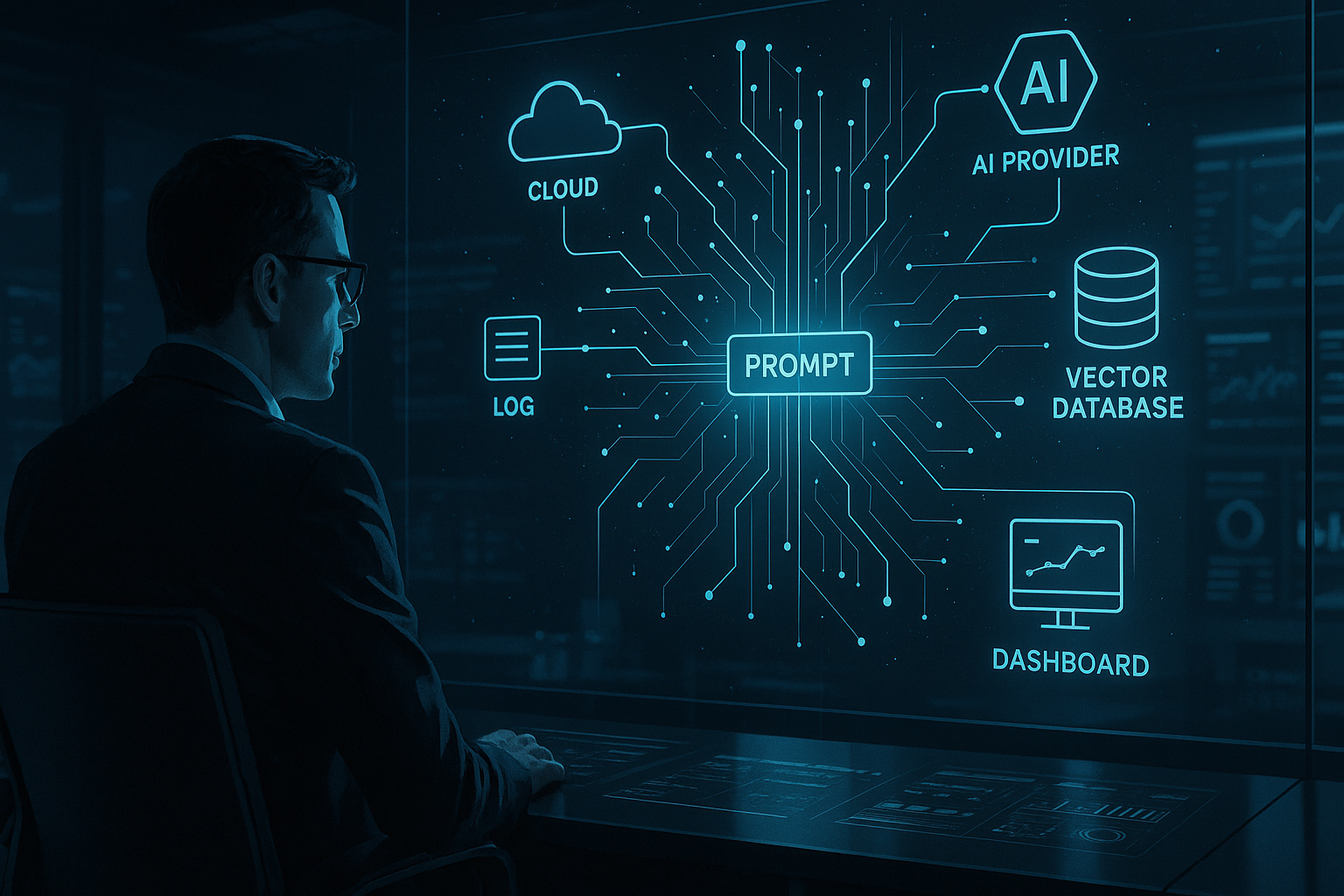

L’adozione dell’intelligenza artificiale nelle aziende sta accelerando, ma c’è una domanda che spesso arriva troppo tardi: dove stanno andando davvero i dati che inviamo ai sistemi AI? Per molti team, l’uso dell’AI inizia in modo apparentemente innocuo: un prompt in un assistente, una feature di summarization, un copilota per il codice, una classificazione automatica di ticket o documenti. Ma ogni interazione può attivare una catena di trasferimenti che coinvolge browser, frontend, backend, API gateway, provider di modelli, sistemi di logging, strumenti di monitoraggio, cache, vector database e servizi terzi. Il punto non è creare allarmismo. Il punto è che non puoi governare ciò che non hai mappato. E se sei un CTO, un engineering manager o un AI product leader, questa mappatura non è un dettaglio operativo: è una responsabilità architetturale, legale e di prodotto. Uno degli errori più comuni è pensare che un prompt sia solo testo temporaneo. In realtà, un prompt può contenere: Quando un utente scrive “riassumi questa email”, “analizza questo contratto” o “spiegami questo stack trace”, non sta solo interagendo con un modello. Sta potenzialmente esportando dati fuori dal perimetro applicativo originario. Questo vale sia per strumenti consumer usati informalmente dai dipendenti, sia per applicazioni AI integrate nei prodotti aziendali. La domanda “dove vanno i dati?” raramente ha una risposta singola. Nella pratica, i dati possono transitare o essere copiati in più livelli. Il dato parte spesso dal browser, da un’app mobile o da un plugin. Già qui possono esistere rischi: estensioni, analytics, session replay, error tracking e strumenti di telemetria possono catturare parti del contenuto inviato. Molte aziende instradano i prompt attraverso il proprio backend per aggiungere autenticazione, rate limiting, policy e osservabilità. È una buona pratica, ma significa anche che il dato può essere scritto in log applicativi, code, cache, tracing distribuito o sistemi di debugging. Se usi API di terze parti, il prompt e spesso anche il contesto allegato vengono inviati a un provider esterno. Qui entrano in gioco aspetti come regione di elaborazione, retention, uso per training, subprocessor, cifratura, isolamento tenant e policy contrattuali. Attorno al modello esiste un ecosistema: moderation API, content filters, vector store, embedding service, object storage, strumenti di valutazione, piattaforme di prompt management e sistemi di analytics. Ognuno può ricevere una copia completa o parziale del dato. Questo è uno dei punti più sottovalutati. Anche quando il provider principale offre garanzie forti, il dato può finire in chiaro nei tuoi log, nei sistemi di APM, nei dashboard di supporto o nei tool di incident analysis. In molte organizzazioni, il rischio maggiore non è il modello: è l’osservabilità non governata. Serve una classificazione minima. Dati pubblici, interni, confidenziali, regolati, personali, segreti industriali: non possono essere trattati tutti allo stesso modo. Se non hai una tassonomia, i team improvviseranno. Non basta sapere quale modello usi. Devi sapere quali sistemi toccano il dato lungo il percorso: provider, subprocessor, storage, logging, support tooling, piattaforme di valutazione e strumenti di terze parti. Retention e caching sono centrali. Un prompt può non essere usato per training, ma essere comunque conservato per debugging, abuse detection o audit. Anche i tuoi sistemi interni potrebbero conservarlo più del necessario. Per molte aziende, la localizzazione del dato è un requisito contrattuale o normativo. “Cloud” non è una risposta sufficiente. Serve sapere dove avviene il processing e se esistono trasferimenti transfrontalieri. La governance non è una slide. È la capacità di mostrare policy, configurazioni, contratti, audit trail, controlli tecnici e ownership chiara. Se domani un cliente enterprise chiede evidenze, devi averle. Quando si parla di dati e AI, la conversazione si concentra spesso solo sulla privacy. È importante, ma non basta. I rischi sono almeno quattro. Codice, documentazione tecnica, roadmap, playbook operativi e dataset proprietari possono uscire dal perimetro aziendale senza che nessuno se ne accorga. Questo è particolarmente critico nei team engineering che usano copiloti o assistant su repository sensibili. Molti contratti con clienti enterprise limitano dove e come i dati possono essere trattati. Anche se non c’è una violazione normativa, può esserci una violazione contrattuale se i dati vengono inviati a provider non autorizzati. Ogni nuovo componente AI aggiunge endpoint, credenziali, pipeline e dipendenze. Più sistemi toccano il dato, più aumenta la superficie di rischio, inclusi errori di configurazione e accessi eccessivi. Il rischio più subdolo è organizzativo. Se l’AI entra in azienda prima delle policy, i team costruiscono eccezioni, workaround e integrazioni opache. Poi diventa difficile standardizzare senza rallentare il business. Molte organizzazioni stanno già usando AI ben oltre gli strumenti ufficiali. Dipendenti che copiano dati in chatbot pubblici, PM che usano tool di note-taking con AI, sviluppatori che installano estensioni, team support che riassumono ticket con servizi esterni. Questo fenomeno ha un nome chiaro: shadow AI. E non si risolve solo con il blocco. Si risolve offrendo alternative sicure, linee guida semplici e un percorso approvato per i casi d’uso ad alto valore. Se la soluzione ufficiale è lenta, complessa o poco utile, il team troverà scorciatoie. La governance efficace non è solo controllo: è anche enablement. Per evitare approcci teorici, conviene lavorare su cinque livelli operativi. Crea un registro semplice ma vivo di tutti i casi d’uso AI: tool interni, feature di prodotto, assistenti di coding, automazioni, workflow documentali. Per ciascuno, mappa owner, dati trattati, provider coinvolti, finalità e criticità. Definisci cosa può essere inviato a sistemi AI e cosa no. Ad esempio: Non lasciare che ogni team scelga strumenti in autonomia. Definisci uno stack approvato: provider, SDK, gateway, librerie di redazione, sistemi di logging sicuri, vector store e policy di accesso. Standardizzare riduce il rischio e accelera i team. Le policy da sole non bastano. Servono controlli implementati nel flusso: I provider cambiano policy, i team aggiungono integrazioni, i prodotti evolvono. Una review trimestrale minima su data flow, contratti e configurazioni evita che il sistema deragli silenziosamente. Dal punto di vista architetturale, uno dei pattern più efficaci è evitare chiamate dirette sparse verso provider AI da parte di molte applicazioni. Meglio introdurre un AI gateway o un layer di orchestrazione centralizzato. Questo layer può gestire: Non è solo una scelta tecnica elegante. È una scelta di governance. Ti permette di sapere chi invia cosa, dove e con quali regole. Molti team si sentono più tranquilli quando non inviano il documento originale ma solo embeddings o chunk indicizzati. È un miglioramento in alcuni scenari, ma non elimina il problema. Gli embeddings possono comunque rappresentare contenuto sensibile. I chunk salvati nel vector database spesso contengono testo quasi integrale. Inoltre, il retrieval può ricostruire contesto riservato e reinviarlo al modello al momento della risposta. In altre parole, anche nei sistemi RAG devi chiederti: Se vuoi una base pratica da applicare subito, questa è una checklist minima: Quasi tutte le aziende useranno AI in modo crescente. La vera domanda non è più se usarla, ma come farlo senza perdere controllo sui dati. I team migliori non sono quelli che bloccano tutto, né quelli che aprono tutto. Sono quelli che costruiscono un sistema in cui innovazione e governance convivono: policy chiare, architettura centralizzata, stack approvato, controlli automatici e ownership definita. Perché ogni volta che usi l’AI, stai inviando dati da qualche parte. E se non sai esattamente dove, chi li vede, quanto restano e con quali garanzie, allora non stai davvero gestendo un prodotto AI: stai solo sperando che vada bene. La maturità AI inizia dalla visibilità dei flussi. Tutto il resto viene dopo.Il falso mito: “sto solo usando un prompt”

I dati non vanno in un solo posto

1. Client e interfaccia

2. Backend applicativo

3. Provider AI esterno

4. Servizi accessori

5. Log e osservabilità

Le 5 domande che ogni leader tecnico dovrebbe fare subito

1. Quali dati entrano nei prompt?

2. Chi riceve questi dati?

3. Per quanto tempo vengono conservati?

4. In quale regione vengono elaborati?

5. Possiamo dimostrare il controllo?

I rischi reali, oltre la privacy

Leakage di proprietà intellettuale

Violazioni contrattuali

Superficie d’attacco più ampia

Debito di governance

Shadow AI: il problema che non compare nei diagrammi

Un modello pratico di governance per team tecnici

1. Inventory dei casi d’uso

2. Classificazione dei dati

3. Approved stack

4. Guardrail tecnici

5. Review periodica

Architettura: il pattern migliore è il controllo centralizzato

RAG, embeddings e vector database: attenzione al “dato derivato”

Checklist essenziale per CTO e AI leader

La domanda giusta non è “possiamo usare l’AI?”

Sottoscriviti ora, e verrai costantemente aggiornato su tutte le novità del mondo IoT e dei miei corsi!